web服务器的网站SEO优化研究

日期 : 2026-03-01 20:36:59

摘要

在互联网竞争日趋激烈的当下,搜索引擎优化(SEO)已成为网站设计提升曝光度、获取自然流量的核心手段,而web服务器作为网站运行的底层基础设施,其性能、配置与运维方式直接影响搜索引擎抓取效率、页面加载体验及用户留存,进而决定SEO优化的最终效果。本文基于web服务器的核心功能的特性,结合当前SEO优化的主流趋势与实战案例,系统分析web服务器对网站SEO的核心影响因素,探索可落地的web服务器层面SEO优化策略,解决服务器配置不合理、性能不足、兼容性差等导致的SEO排名瓶颈问题,为网站运营者提供兼具理论性与实操性的参考,助力网站实现自然流量的持续增长与排名提升。

关键词

web服务器;SEO优化;页面加载速度;搜索引擎抓取;服务器配置

一、引言

随着数字化转型的深入,网站已成为企业展示品牌、获取客户、开展业务的核心载体,而搜索引擎作为用户获取网络信息的主要渠道,其排名结果直接决定网站的流量与价值。SEO优化通过优化网站结构、内容质量、技术配置等,提升网站在搜索引擎结果页(SERP)的排名,从而实现自然流量的精准获取。

web服务器作为网站数据存储、请求响应、内容分发的核心枢纽,是连接用户与网站内容的桥梁,其运行状态直接影响搜索引擎爬虫的抓取效率、页面加载速度、网站稳定性等关键SEO指标。当前,多数网站运营者在SEO优化中过度聚焦于前端内容打磨与外链建设,忽视了web服务器底层配置的优化,导致出现爬虫抓取失败、页面加载延迟、网站频繁宕机等问题,严重制约SEO效果的发挥。

基于此,本文聚焦web服务器与网站SEO的内在关联,深入剖析web服务器对SEO优化的核心影响,结合Tomcat等主流web服务器的实操案例,提出针对性的优化策略,为网站运营者突破SEO瓶颈、提升核心竞争力提供理论支撑与实践指导。

二、web服务器与网站SEO的核心关联

web服务器的核心功能是接收用户HTTP请求、处理请求并返回相应的网页资源,其性能与配置直接作用于搜索引擎爬虫抓取和用户访问体验两大核心环节,而这两大环节正是SEO优化的核心切入点。搜索引擎算法(如谷歌Core Web Vitals、百度体验星标)已将服务器相关指标纳入排名权重体系,服务器层面的优化成为SEO竞争的“隐性门槛”。

2.1 服务器性能决定页面加载体验

页面加载速度是SEO排名的核心权重之一,也是用户体验的“第一公里”。搜索引擎算法明确将页面加载速度、首字节时间(TTFB)等指标纳入评估体系,加载速度过慢会直接导致搜索引擎排名下降、用户跳出率升高。近期一项覆盖676个行业、7718家企业的研究显示,排名前10的搜索结果在服务器响应速度上始终优于竞争对手,其中TTFB作为反映服务器接收请求并开始发送数据的核心指标,直接决定了页面加载的基础效率。

web服务器的CPU性能、内存大小、带宽吞吐量等核心参数,直接决定了页面加载速度。配置过低的服务器会导致请求响应延迟,即使前端代码优化完善,也会被底层性能拖累,出现页面白屏、资源加载失败等问题。例如,某企业官网未优化服务器配置时,页面加载时间长达4秒,跳出率高达60%;优化服务器配置后,加载时间缩短至1.5秒,跳出率降低40%,自然搜索流量显著提升。

2.2 服务器稳定性影响爬虫抓取效率

搜索引擎爬虫(如百度蜘蛛、谷歌bot)通过定期访问网站、抓取页面内容并建立索引,实现网站在搜索结果中的展示。而web服务器的稳定性直接决定爬虫的抓取频次与抓取质量,若服务器频繁宕机、响应超时,爬虫会降低访问频次,甚至停止抓取,导致网站新内容无法及时索引、旧页面优化无法更新,最终影响排名。

这一逻辑类似线下商铺经营:若商铺频繁关门,顾客会逐渐减少到访;同理,若爬虫多次访问网站遭遇宕机或错误响应,搜索引擎会判定网站不可靠,进而降低抓取优先级。此外,服务器的并发处理能力也会影响爬虫抓取效率,当网站流量激增或爬虫集中访问时,性能不足的服务器会出现请求拥堵,导致爬虫抓取失败,浪费抓取配额。

2.3 服务器配置影响搜索引擎兼容性

搜索引擎爬虫对网页资源的抓取依赖于web服务器的配置,不合理的服务器配置会导致爬虫无法正常解析页面内容、获取关键信息,进而影响索引与排名。例如,服务器未开启URL重写功能,动态URL中的复杂参数会导致爬虫陷入“抓取黑洞”,无法有效抓取页面;未正确配置HTTP状态码,会出现404错误滥用、200状态码返回无效页面等问题,浪费抓取资源;禁用搜索引擎爬虫的UA或IP,会直接导致爬虫无法访问网站,彻底丧失SEO排名基础。

2.4 服务器安全与合规性奠定SEO基础

搜索引擎优先收录安全、合规的网站,web服务器的安全配置直接影响网站的信任度与合规性。未配置SSL证书、未开启HTTPS协议的网站,会被搜索引擎标记为“不安全”,排名优先级降低,甚至被拦截;服务器遭受DDoS攻击、恶意入侵等安全问题,会导致网站无法正常访问,同时影响网站IP声誉,若使用共享主机,还可能因同IP下其他网站的恶意行为受到牵连,间接影响SEO排名。

三、web服务器影响网站SEO的核心因素分析

结合web服务器的运行机制与SEO优化的核心需求,从性能、配置、运维、安全四个维度,剖析影响网站SEO的关键服务器因素,为后续优化策略的制定提供依据。

3.1 服务器性能因素

服务器性能是影响SEO的基础因素,核心包括硬件配置与运行效率两个层面:

- 硬件配置:CPU核心数、内存容量、带宽大小直接决定服务器的处理能力与数据传输速度。CPU核心数越多,处理并发请求的能力越强;内存容量越大,可缓存的网页资源越多,减少重复请求的处理时间;带宽越大,数据传输速度越快,尤其对于图片、视频等大体积资源,带宽不足会导致加载延迟。例如,北方用户访问部署在南方电信服务器的网站,若使用单线服务器,会因跨网访问导致带宽瓶颈,加载速度显著下降。

- 运行效率:服务器的操作系统、运行环境优化程度影响性能发挥。例如,Windows Server与Linux系统的性能侧重不同,Linux系统在稳定性、安全性上更具优势,更适合SEO优化需求;服务器后台无用进程过多、资源占用过高,会导致响应速度下降,影响爬虫抓取与用户访问。

3.2 服务器配置因素

合理的服务器配置是保障搜索引擎抓取与页面正常展示的关键,核心影响因素包括:

- URL配置:动态URL的静态化处理是SEO优化的重要环节,服务器需支持URL重写功能,将带有复杂参数的动态URL转换为简洁、静态的URL,提升爬虫抓取效率。某电商网站通过URL重写优化,将动态参数URL转换为静态路径,3个月内自然搜索流量增长150%。

- HTTP协议与状态码配置:开启HTTPS协议并配置SSL证书,是当前SEO的基础要求;正确配置HTTP状态码,如404状态码用于无效页面、503状态码用于服务器临时维护,避免出现200状态码返回无效页面、404状态码滥用等问题,避免浪费爬虫抓取资源。

- 缓存配置:服务器缓存(如浏览器缓存、CDN缓存)可减少重复请求的处理时间,提升页面加载速度。合理配置缓存策略,将不常更新的静态资源(如图片、CSS、JS文件)进行缓存,可显著降低服务器负载,同时提升用户访问与爬虫抓取体验。

- robots.txt配置:通过robots.txt文件指定爬虫可抓取与禁止抓取的页面,避免爬虫抓取后台页面、重复页面等无价值内容,节省抓取配额,提升核心页面的抓取优先级。

3.3 服务器运维因素

服务器的日常运维直接影响其稳定性与性能发挥,核心影响因素包括:

- 宕机维护:服务器的宕机频率与维护时间直接影响网站可用性。频繁宕机会导致爬虫抓取失败、用户无法访问,长期会降低搜索引擎对网站的信任度;维护时未配置503状态码,会被搜索引擎判定为页面失效,影响索引。

- 资源监控:未及时监控服务器的CPU、内存、带宽等资源使用情况,会导致资源过载,出现响应延迟、宕机等问题;未监控爬虫访问日志,无法及时发现爬虫抓取异常,错失优化机会。

- 服务器迁移:服务器迁移过程中,若未做好301重定向、IP更换通知等操作,会导致页面权重流失、爬虫无法识别新服务器地址,进而影响SEO排名。某汽车零部件厂商因服务器迁移未做好优化,核心关键词排名跌至50名开外,被迫投入额外成本进行二次优化。

3.4 服务器安全与IP因素

- 安全防护:服务器未部署Web应用防火墙(WAF)、未定期进行安全升级,易遭受DDoS攻击、恶意入侵等,导致网站无法正常访问,同时影响网站信任度,被搜索引擎降权。

- IP声誉:使用共享主机时,若同IP下其他网站存在垃圾邮件、恶意行为等,会影响自身网站的IP声誉,导致搜索引擎降权;使用被惩罚过的IP地址,会直接影响网站的索引与排名。

四、web服务器层面的网站SEO优化策略

基于上述影响因素分析,结合Tomcat、Nginx等主流web服务器的实操特性,从性能优化、配置优化、运维优化、安全优化四个维度,提出可落地的SEO优化策略,实现服务器与SEO的协同提升。

4.1 服务器性能优化:提升加载速度与并发能力

性能优化的核心目标是缩短页面加载时间、提升服务器并发处理能力,契合搜索引擎对页面体验的考核要求,具体策略如下:

- 优化硬件配置:结合网站规模与流量需求,合理选择服务器硬件配置。小型网站可选择2核4G内存、10M以上带宽;中大型网站需提升CPU核心数、内存容量,选择50M以上带宽,避免带宽瓶颈。针对跨区域用户,选择双线或多线服务器,平衡南北地区访问速度;针对跨境网站,选择目标市场就近的服务器节点,如东南亚市场选择新加坡节点,可提升本地搜索排名3-5位。

- 优化运行环境:优先选择Linux操作系统(如CentOS、Ubuntu),其稳定性、安全性与运行效率更适合SEO需求;精简服务器后台无用进程,关闭不必要的服务,释放系统资源;优化数据库配置,减少数据库查询延迟,提升动态页面加载速度。以Tomcat服务器为例,可优化conf/server.xml配置文件中的连接器参数,提升请求处理效率。

- 启用资源压缩与缓存:开启服务器Gzip压缩功能,对HTML、CSS、JS等文本资源进行压缩,减少资源体积,提升传输速度;配置浏览器缓存,设置静态资源的缓存时间,避免用户重复访问时重新加载资源;引入CDN加速服务,将网站资源缓存到全国乃至全球节点,用户与爬虫访问时从最近节点获取资源,降低延迟。跨境网站可选用Cloudflare CDN,国内网站可选用百度云加速,同时开启HTTP/2协议,实现单个连接并行处理多个请求,进一步提升加载速度。

4.2 服务器配置优化:提升抓取效率与兼容性

配置优化的核心目标是让搜索引擎爬虫高效抓取、正确解析页面内容,提升网站索引质量,具体策略如下:

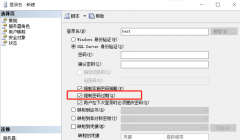

- URL静态化优化:开启服务器URL重写功能,将动态URL转换为简洁、包含核心关键词的静态URL。例如,将“www.xxx.com?id=123”转换为“www.xxx.com/keyword/123.html”,URL长度控制在60个字符以内,使用短横线“-”分隔单词,避免下划线与中文,提升爬虫抓取效率与用户体验。Tomcat服务器可通过配置web.xml文件实现URL重写,Nginx服务器可通过rewrite指令配置。

- HTTP协议与状态码优化:申请SSL证书,强制开启HTTPS协议,设置301重定向将HTTP请求跳转至HTTPS,避免权重流失;统一域名解析,将www与非www域名定向到同一站点,避免被搜索引擎判定为两个网站。正确配置HTTP状态码,无效页面返回404状态码,服务器临时维护返回503状态码,避免出现200状态码返回无效页面的情况;对于已删除的页面,设置301重定向至相关核心页面,保留页面权重。

- robots.txt与站点地图优化:编写规范的robots.txt文件,明确禁止爬虫抓取后台页面、重复页面、无价值标签页等,节省抓取配额;生成站点地图(sitemap.xml),包含网站核心页面的URL、更新时间等信息,提交至百度搜索资源平台、Google Search Console,方便爬虫批量抓取。定期更新站点地图,确保新页面及时被爬虫发现。

- 适配移动优先索引:当前搜索引擎均采用移动优先索引策略,服务器需支持响应式设计,确保网站在手机、平板、电脑等不同设备上正常展示;优化移动端资源加载速度,禁用不必要的动画与弹窗,适配触屏交互,提升移动端用户体验,进而提升移动搜索排名。新闻类站点可使用AMP技术进一步提升移动端加载效率。

4.3 服务器运维优化:保障稳定性与可持续性

运维优化的核心目标是保障服务器稳定运行,减少宕机风险,确保爬虫抓取与用户访问的连续性,具体策略如下:

- 建立常态化监控机制:部署服务器监控工具(如New Relic APM、ELK Stack),实时监控CPU、内存、带宽、磁盘空间等资源使用情况,设置预警阈值,当资源过载时及时预警并处理;监控爬虫访问日志,分析爬虫抓取频率、抓取页面、抓取异常等情况,及时调整优化策略。通过Screaming Frog等爬虫模拟器,定期扫描网站,提前发现404错误、重复内容等问题。

- 优化宕机与维护管理:选择稳定性高的服务器服务商,确保服务器年 uptime 达到99.9%以上;服务器维护时,提前规划维护时间,选择流量低谷期(如凌晨)进行,配置503状态码并添加维护提示,告知搜索引擎与用户网站临时不可访问,避免被判定为页面失效;定期备份网站数据与服务器配置,防止数据丢失,减少宕机后的恢复时间。

- 规范服务器迁移流程:若需进行服务器迁移,提前做好规划,将旧服务器的页面通过301重定向至新服务器对应页面,保留页面权重;在搜索引擎平台提交服务器IP更换通知,告知爬虫新的服务器地址;迁移完成后,监控爬虫抓取情况,及时处理抓取异常,确保索引不受影响。

4.4 服务器安全优化:提升信任度与合规性

安全优化的核心目标是保障网站安全合规,提升搜索引擎与用户的信任度,具体策略如下:

- 部署安全防护措施:安装Web应用防火墙(WAF),防范DDoS攻击、SQL注入、恶意爬虫等安全威胁;定期更新服务器操作系统、运行环境与应用程序,修复安全漏洞;禁止不必要的端口开放,减少安全隐患。

- 优化IP与主机选择:优先选择专用IP地址,避免使用共享IP,防止因同IP下其他网站的恶意行为影响自身IP声誉;选择口碑良好、合规的服务器服务商,避免使用被搜索引擎惩罚过的IP地址与主机。

- 保障数据安全与合规:定期备份网站数据,防止数据泄露与丢失;遵守相关法律法规,完善网站隐私政策、使用条款等页面,添加nofollow标签,避免分散页面权重,同时提升网站合规性。

五、优化案例分析

为验证上述优化策略的有效性,结合两个不同类型的网站案例,分析web服务器层面SEO优化的实施过程与效果,为实践应用提供参考。

5.1 案例一:Tomcat服务器JSP网站优化

某新闻门户网站采用Tomcat服务器部署JSP动态网站,优化前存在页面加载速度慢(平均加载时间4.2秒)、爬虫抓取效率低、自然搜索流量少等问题。结合本文提出的优化策略,实施以下优化措施:

- 性能优化:升级服务器配置至4核8G内存、50M带宽,开启Gzip压缩,引入CDN加速服务,优化Tomcat服务器连接器配置;合理使用JSP的include指令和静态资源缓存,平衡内容动态更新与抓取友好性。

- 配置优化:开启URL重写功能,将动态URL转换为静态URL;生成站点地图并提交至搜索引擎,优化robots.txt文件,禁止抓取无价值标签页;开启HTTPS协议,设置301重定向;为图片添加描述性ALT文本,优化结构化数据标记。

- 运维优化:部署服务器监控工具,实时监控资源使用情况;选择凌晨进行服务器维护,配置503状态码;定期备份网站数据与配置。

优化实施3个月后,网站页面平均加载时间缩短至1.4秒,爬虫抓取频次提升60%,核心关键词排名进入搜索引擎前10,自然搜索流量增长180%,用户停留时间延长35%,优化效果显著。

5.2 案例二:跨境电商网站服务器优化

某跨境电商网站主攻东南亚市场,优化前部署在美国东部服务器,存在页面加载延迟(东南亚用户平均加载时间3.8秒)、IP声誉不佳、爬虫抓取异常等问题,导致自然搜索流量低迷。实施以下优化措施:

- 性能优化:将服务器迁移至新加坡节点,选用4核8G内存、100M带宽的服务器,启用Cloudflare企业版CDN,配置HTTP/3+QUIC协议,优化静态资源缓存策略。

- 配置优化:优化URL结构,实现静态化处理;开启HTTPS协议,配置301重定向;生成多语言站点地图,提交至Google Search Console;优化移动端响应式设计,提升移动端加载速度。

- 安全优化:部署WAF防护,选用专用IP地址,定期进行安全升级与漏洞修复;完善隐私政策与用户协议,提升网站合规性。

优化实施2个月后,东南亚市场页面加载速度缩短至1.5秒,自然搜索流量增长140%,核心产品关键词排名提升15-20位,IP声誉显著改善,用户转化率提升25%。

六、SEO优化效果评估体系

为确保web服务器层面SEO优化的有效性,建立科学的效果评估体系,从服务器性能、爬虫抓取、搜索排名、流量转化四个维度设定评估指标,定期监测优化效果,及时调整优化策略。

6.1 服务器性能指标

核心评估指标包括:服务器响应时间(TTFB)、页面加载时间、服务器 uptime 率、CPU/内存/带宽使用率、并发处理能力。通过PageSpeed Insights、Lighthouse等工具监测页面加载速度,通过服务器监控工具监测资源使用情况,确保服务器性能达到优化目标。

6.2 爬虫抓取指标

核心评估指标包括:爬虫抓取频次、抓取成功率、索引覆盖率、新页面索引时间。通过搜索引擎平台(百度搜索资源平台、Google Search Console)监测爬虫抓取数据,分析抓取异常原因,优化抓取效率。

6.3 搜索排名与流量指标

核心评估指标包括:核心关键词排名、长尾关键词排名、自然搜索流量、搜索展现量、点击率。通过SEO监测工具(Ahrefs、SEMrush、百度指数)监测排名与流量变化,评估优化对排名的提升效果。

6.4 流量转化指标

核心评估指标包括:用户跳出率、页面停留时间、转化率(咨询转化、购买转化)。通过网站统计工具(百度统计、Google Analytics)监测用户行为数据,评估优化对用户体验与转化的提升效果。

七、结论与展望

7.1 结论

web服务器作为网站运行的底层基础设施,其性能、配置、运维与安全直接影响搜索引擎抓取效率、页面加载体验与用户留存,进而决定SEO优化的最终效果。当前,web服务器层面的优化已成为SEO竞争的核心环节,忽视服务器优化会导致前端内容优化与外链建设的效果大打折扣。

本文通过分析web服务器对网站SEO的核心影响因素,提出了性能优化、配置优化、运维优化、安全优化四大维度的具体策略,并通过两个实战案例验证了策略的有效性。研究表明,通过合理优化web服务器配置、提升服务器性能、加强运维管理与安全防护,可有效提升爬虫抓取效率、缩短页面加载时间、提升搜索排名与自然流量,实现网站SEO效果的持续提升。同时,建立科学的效果评估体系,可及时监测优化效果,确保优化策略的针对性与可持续性。

此外,服务器与外链建设、内容优化是SEO优化的三大核心支柱,三者缺一不可:高性能服务器是流量的承载体,高质量外链是流量的驱动力,优质内容是流量的留存基础,只有实现三者协同优化,才能达到1+1>2的资产增值效应。

7.2 展望

随着人工智能、大数据技术的发展,搜索引擎算法不断迭代,web服务器的SEO优化也将呈现智能化、精细化的发展趋势。未来,可进一步探索AI技术在服务器运维与SEO优化中的应用,如通过AI实现服务器资源的动态分配、爬虫抓取行为的智能分析、优化策略的自动调整,提升优化效率与效果。

同时,随着边缘计算技术的普及,可将网站资源部署在边缘节点,进一步缩短页面加载时间,提升跨区域用户与爬虫的访问体验;结合5G技术的发展,优化服务器的并发处理能力,应对高流量场景下的访问需求。此外,随着AI内容合规化成为SEO趋势,需进一步加强服务器与内容优化的协同,确保网站内容与技术配置均符合搜索引擎算法要求,实现网站自然流量的长期稳定增长。

上一篇:传统行业网站建设注意

下一篇:人工智能:重塑网站生态

相关文章

相关文章

精彩导读

精彩导读

热门资讯

热门资讯