企业网站优化秘籍:让搜索引擎轻松

日期 : 2026-04-03 21:06:49

企业网站的核心价值,在于让目标客户通过搜索引擎找到自己。而这一切的前提,是让搜索引擎“读懂”你的网站——清晰识别网站结构、抓取核心内容、判定页面价值。多数企业投入资源建站后,却因忽视优化细节,导致网站被搜索引擎“冷落”,优质内容无法曝光。以下这份实操秘籍,从技术、结构、内容、细节四大维度,教你低成本实现优化,让搜索引擎轻松识别,抢占自然流量红利。

一、技术优化:打通搜索引擎“抓取通道”

搜索引擎通过爬虫(如Googlebot)抓取网站内容,再进行渲染、索引,最终参与排名。技术优化的核心,是消除爬虫抓取障碍,让这一流程顺畅高效,这也是搜索引擎能否识别网站的基础环节。

1. 配置Robots.txt:给爬虫“明确指引”

Robots.txt是放在网站根目录的文本文件,相当于给搜索引擎爬虫的“导航手册”,明确告知其哪些页面可爬、哪些需避开。正确配置能避免爬虫浪费资源在无关页面(如后台管理页、购物车页),同时引导其优先抓取核心内容。

核心配置示例(适配多数企业站):

User-agent: *

Disallow: /admin/

Disallow: /cart/

Disallow: /checkout/

Allow: /

Sitemap: https://example.com/sitemap.xml

关键提醒:避免两大常见错误——一是Disallow: / 禁止所有爬取,导致整个网站从搜索结果消失;二是屏蔽CSS、JS文件,导致搜索引擎无法渲染页面,影响排名判断。此外,Robots.txt仅能阻止爬取,无法阻止索引,若需彻底禁止页面被索引,需搭配noindex标签使用。

2. 提交XML Sitemap:给爬虫“画好地图”

XML Sitemap是列出网站所有重要页面的文件,虽不直接提升排名,但能帮助搜索引擎快速发现核心页面,尤其适合页面较多的企业站。优化重点的是:仅包含需索引的页面,剔除404、重定向、noindex页面;确保Sitemap中的URL为规范链接(Canonical URL);准确填写页面最后修改时间(lastmod),让爬虫知晓内容更新节奏。

实操建议:大型企业站(页面超5万个)可使用Sitemap Index文件拆分管理,将产品页、栏目页、资讯页分类创建Sitemap,提升抓取效率;同时在Robots.txt中声明Sitemap位置,并在Google Search Console、百度搜索资源平台手动提交,便于监控索引状态。

3. 优化页面加载速度与多端适配

搜索引擎优先收录加载流畅、体验优质的网站,页面加载速度直接影响爬虫抓取频率和用户留存。核心优化动作:压缩图片(采用WebP格式、开启懒加载),压缩CSS、JS文件;减少页面重定向,启用CDN加速;优化核心Web指标,确保最大内容渲染时间(LCP)≤2.5秒、累积布局偏移(CLS)≤0.1。

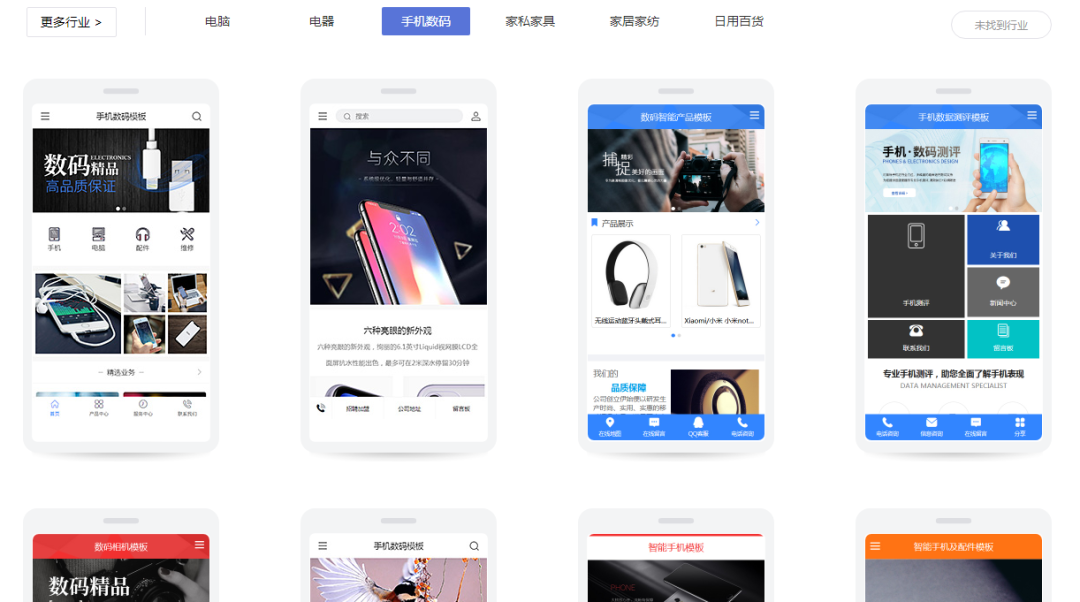

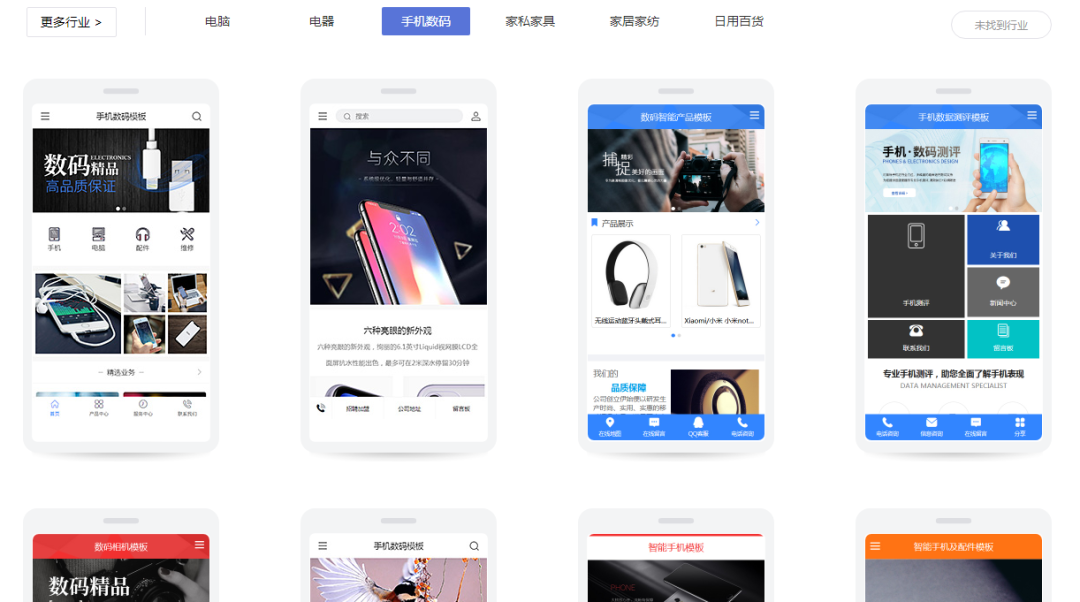

同时,当前移动端访问占比超75%,需实现多端自适应,确保PC端、移动端、小程序的架构逻辑统一、内容互通,避免独立移动端URL,采用响应式设计,让爬虫在不同终端都能顺畅抓取内容。

二、结构优化:让搜索引擎“理清脉络”

网站结构如同“骨架”,清晰的结构能让搜索引擎快速理解页面层级、核心内容分布,同时提升用户体验,间接提升识别权重。核心原则是“扁平化、清晰化、闭环化”。

1. 采用三级扁平化架构

遵循“首页→栏目页→内容页”的三级架构,确保任何内容页从首页点击不超过3次,避免深层嵌套导致爬虫无法抓取底层页面。例如,某垂直家居企业将原有四级架构(首页→风格分类→产品类型→内容页)调整为三级后,核心页面收录率从40%提升至85%,自然流量翻倍。

实操细节:导航栏设计简洁,核心栏目不超过8个,采用“主导航+次导航”结构,主导航放置核心业务(如产品中心、解决方案),次导航放置辅助内容(如关于我们、联系我们);移动端导航可折叠为“汉堡菜单”,节省空间且不影响抓取。

2. 优化内部链接:打造“权重闭环”

内部链接如同网站的“血管”,负责传递页面权重,同时引导爬虫抓取更多核心页面。优化需遵循四大原则:一是相关性优先,链接需与当前页面内容强相关(如产品详情页链接到相关产品、使用指南),避免无关链接被判定为垃圾链接;二是权重集中,将权重向核心页面(首页、核心产品页)倾斜,首页链接所有栏目页,栏目页链接对应内容页,核心内容页互相链接;三是自然分布,单篇1000字左右的内容页,内部链接控制在3-5个,避免堆砌;四是闭环设计,让用户和爬虫能通过内部链接回溯,形成“首页→栏目页→内容页→栏目页/首页”的闭环。

加分技巧:在内容页底部添加“相关推荐”模块,推荐强相关内容,既能增加内部链接数量,又能提升用户停留时长,间接提升搜索引擎对网站价值的判定。

3. 规范URL设计

URL是搜索引擎识别页面的重要标识,优化重点:采用静态URL(如https://example.com/product/industrial-robot),避免动态URL(如https://example.com/page?id=123);URL简洁易读,包含核心关键词,长度控制在60字符以内;层级清晰,用“/”分隔,避免过多层级(如不超过3级);统一URL大小写,避免出现多个URL指向同一页面的情况,若存在重复页面,需使用Canonical标签指定权威版本,解决重复内容问题。

三、内容优化:给搜索引擎“核心价值”

搜索引擎识别网站设计的核心,是判断其内容是否能满足用户需求。优质内容不仅能提升抓取优先级,还能获得更高排名和用户信任,这是企业网站优化的核心竞争力。

1. 精准布局关键词:让搜索引擎“抓准主题”

关键词是搜索引擎与网站内容的“连接桥梁”,布局核心是“精准、自然、全覆盖”。实操步骤:

- 核心关键词:选择与企业核心业务匹配、搜索量500-5000的中等竞争词(如“工业机器人厂家”比“机器人”更精准),通过5118、百度指数等工具筛选,避免与行业巨头正面竞争;核心关键词需自然融入首页标题、Meta描述、H1标签及正文首段,密度控制在2%-8%,避免堆砌。

- 长尾关键词:挖掘“问题式+场景式+对比式”长尾词(如“深圳雅思培训哪家好”“工业机器人选型避坑指南”),这类关键词搜索量虽低,但转化率高,可布局在产品详情页、资讯页、FAQ页面,丰富关键词覆盖维度。

- 语义化关键词:随着搜索引擎算法升级,需结合核心关键词拓展语义相关词(如“工业机器人”拓展“工业机器人型号”“工业机器人维护”),让内容更贴合用户搜索意图,提升识别精准度。

2. 打造高质量内容:满足用户与搜索引擎双重需求

内容质量的核心是“原创、实用、权威、时效”,这四大维度直接决定搜索引擎对页面价值的判定:

- 原创性:搜索引擎对原创内容抓取优先级更高,原创文章收录率比伪原创高3-5倍,企业可通过深度行业分析、独家案例解读、产品实操指南等打造差异化内容,避免同质化竞争。

- 实用性:内容需具备可操作性,如提供《行业选型避坑指南》《产品使用技巧合集》,解决用户实际问题,提升用户停留时长和互动率,间接向搜索引擎传递“高价值”信号。

- 权威性:引用行业报告、专家观点、政府数据,或展示企业资质、案例成果,提升内容可信度,增强搜索引擎对网站专业性的认可。

上一篇:以字建索引,开启数字化新征程

下一篇:企业网站网页设计中的计算机图像处理技术

相关文章

相关文章

精彩导读

精彩导读

热门资讯

热门资讯