Web服务器的网站SEO优化研究

日期 : 2026-04-07 00:07:25

在数字化时代,网站作为企业与用户对接的核心载体,其搜索引擎优化(SEO)效果直接决定了网站的曝光量、流量转化效率与市场竞争力。Web服务器作为网站运行的底层支撑,其性能表现、稳定性、配置合理性不仅影响网站的访问体验,更直接作用于搜索引擎爬虫抓取效率与排名权重分配。当前,多数SEO优化实践聚焦于内容创作、关键词布局与外链建设,却忽视了Web服务器这一核心底层因素的赋能价值。本文基于搜索引擎算法规则与Web服务器运行原理,系统分析Web服务器对网站SEO的核心影响机理,梳理服务器层面的SEO优化关键点与实操策略,结合实战案例验证优化效果,提出科学可行的实施路径,为网站运营者提升SEO效能、实现可持续流量增长提供理论支撑与实践参考。

关键词

Web服务器;SEO优化;性能优化;爬虫抓取;稳定性;用户体验

一、绪论

1.1 研究背景

随着互联网技术的快速迭代与搜索引擎算法的不断升级,SEO已从简单的关键词堆砌、外链建设,演进为融合技术优化、内容质量、用户体验与品牌信任的系统工程。截至2026年,全球生成式AI市场规模突破1.2万亿美元,AI驱动的搜索算法(如Google的AI Overviews)正重塑SEO生态,搜索引擎对网站的评价维度更加多元,其中Web服务器的底层支撑作用愈发凸显。百度“闪电算法”、Google Core Web Vitals等明确将页面加载速度、网站稳定性纳入核心排名因素,服务器性能不足、配置不合理导致的页面卡顿、宕机等问题,会直接导致网站排名下滑、流量流失,甚至被搜索引擎降权屏蔽。在此背景下,从Web服务器层面切入,开展SEO优化研究,成为破解当前SEO优化瓶颈、提升网站核心竞争力的关键突破口。

1.2 研究意义

本文的研究意义主要体现在理论与实践两个层面:在理论层面,填补了当前SEO优化研究中对Web服务器底层支撑作用的研究空白,明确Web服务器与SEO优化的内在关联机制,丰富SEO优化的理论体系;在实践层面,梳理Web服务器层面可落地的SEO优化策略,结合实战案例提供可参考的实施方法,帮助网站运营者避开优化误区,降低优化成本,提升搜索引擎排名与自然流量,实现网站流量与业务转化的双重提升。

1.3 研究现状

当前国内外关于SEO优化的研究已较为成熟,主要集中于内容优化、关键词策略、外链建设、移动端适配等表层维度,相关研究多围绕搜索引擎算法更新,探讨如何通过内容创作与页面设计提升排名。但针对Web服务器与SEO优化的关联性研究相对匮乏,现有研究多聚焦于服务器性能优化本身,未能将其与SEO排名机制、爬虫抓取逻辑、用户体验需求深度结合。部分研究提及服务器速度对SEO的影响,但缺乏系统的优化策略与实战验证,未能形成“影响机理-优化策略-实施落地-效果评估”的完整研究体系,难以满足网站运营者的实际优化需求。

1.4 研究方法与内容

本文采用文献研究法、案例分析法与实证研究法相结合的方式开展研究:通过文献研究,梳理Web服务器运行原理、搜索引擎爬虫抓取机制与SEO排名规则,明确二者的内在关联;通过案例分析法,选取不同类型网站的服务器优化案例,分析优化策略与实施效果;通过实证研究,总结Web服务器SEO优化的核心关键点与实施路径。研究内容主要包括:Web服务器对网站SEO的核心影响机理、Web服务器SEO优化的核心策略、优化实施路径与效果评估、典型案例分析及未来优化趋势展望。

二、Web服务器与网站SEO的核心关联机理

Web服务器作为网站的“硬件基石”,是网站内容存储、数据传输、请求响应的核心载体,其运行状态直接传导至搜索引擎爬虫抓取效率与用户访问体验,最终影响网站SEO排名。搜索引擎的核心目标是为用户推荐体验优质、服务可靠的网站,而Web服务器的性能、稳定性与安全性,正是搜索引擎评估网站质量的重要底层指标,二者的关联主要体现在三个核心维度。

2.1 服务器性能影响用户体验,传导至SEO排名

用户体验是搜索引擎排名的核心权重之一,而Web服务器性能直接决定了页面加载速度、响应延迟等关键体验指标。Google研究显示,页面加载每延迟1秒,跳出率可能上升32%,高跳出率会被搜索引擎判定为“体验劣质”,直接降低排名权重;百度“闪电算法”更明确规定,移动端首屏加载超3秒将对排名产生负面影响,2秒内完成加载则可获得排位提升。服务器带宽不足、CPU与内存配置过低、存储介质读取速度慢等问题,会导致页面加载卡顿、响应延迟,不仅会降低用户留存率与转化率,更会通过用户行为数据(跳出率、停留时间、互动频率)向搜索引擎传递负面信号,导致网站排名下滑。

2.2 服务器稳定性影响爬虫抓取效率,决定收录质量

搜索引擎爬虫的正常抓取是网站被收录、获得排名的前提,而Web服务器的稳定性直接影响爬虫抓取效率与抓取频率。服务器频繁宕机、响应超时,会导致爬虫无法正常访问网站、抓取内容,长期下来会被搜索引擎判定为“服务不可靠”,进而减少爬取频率、降低收录量,甚至取消部分已收录页面的排名权重。此外,服务器配置不合理(如并发处理能力不足)会导致爬虫访问时出现拥堵、超时,影响爬虫对网站内容的全面抓取,导致核心内容无法被收录,错失排名机会。

2.3 服务器安全性影响网站信任度,规避SEO惩罚

搜索引擎对网站安全性的要求日益提高,Web服务器安全防护薄弱易导致网站被篡改、挂黑链、遭受DDoS攻击等安全问题,搜索引擎检测到此类问题后,会直接对网站降权或屏蔽,前期所有SEO投入将付诸东流。HTTPS协议作为网站安全的核心保障,不仅能实现数据加密传输,更被Google、百度等搜索引擎纳入排名信号,2024年Google算法中HTTPS的权重占比约5-8%,未部署HTTPS的网站不仅会被Chrome浏览器标记“不安全”,导致跳出率上升35%,还会在排名中处于劣势,平均排名比HTTPS网站低2.5位,点击率与转化率也显著低于HTTPS网站。

三、Web服务器的网站SEO核心优化策略

基于Web服务器对SEO的核心影响机理,结合搜索引擎算法规则与网站运营实际需求,本文从性能优化、稳定性优化、安全优化、爬虫适配优化四个维度,梳理Web服务器层面可落地的SEO优化策略,实现“底层支撑强化-用户体验提升-爬虫抓取优化-排名权重提升”的闭环。

3.1 性能优化:以速度为核心,赋能SEO排名

页面加载速度是搜索引擎明确的排名因素,而Web服务器的配置、资源处理能力是决定加载速度的核心变量。围绕服务器层面的性能优化,需从硬件配置、资源加载、CDN加速三个维度落地实施。

3.1.1 硬件资源配置优化

硬件资源直接决定服务器的基础处理能力,需根据网站规模与流量需求合理配置,避免资源不足或浪费。在带宽配置方面,带宽作为数据传输的“通道”,其宽度与独享性直接影响加载速度:个人博客、小型站点每日几百访问量,配置1-2M独享带宽即可;电商、高频更新站点每日几千访问量,需预留3-5M带宽,并根据带宽使用监控数据动态升级,坚决避开共享带宽陷阱,防止高峰期被其他网站占用资源导致卡顿。在CPU与内存配置方面,动态页面(含评论、实时推荐功能)的生成依赖CPU与内存的计算能力,建议个人博客采用1核2G内存,电商、论坛类站点采用2核4G及以上配置,确保CPU使用率稳定在80%以下;同时优先选择SSD固态硬盘,其读取速度比传统机械硬盘快5-10倍,可大幅减少数据读取延迟,提升页面加载速度。

3.1.2 资源加载效率优化

通过服务器配置优化资源传输与处理逻辑,减少不必要的加载损耗,提升页面渲染速度。一是启用压缩技术,对文本、CSS、JavaScript等资源启用Gzip或Brotli压缩,可使文件体积减少30%以上,其中Brotli压缩效果优于Gzip,以Nginx服务器为例,可通过以下配置启用Brotli压缩:

brotli on;

brotli_types text/plain text/css application/json application/javascript text/xml application/xml application/xml+rss text/javascript;

二是优化图片与媒体资源,服务器端可配置自动转换图片格式,优先使用WebP或AVIF格式(比JPG小30%-50%),图标采用SVG格式;对非首屏图片启用延迟加载,首屏核心图片通过fetchpriority="high"设置优先加载,避免首屏加载压力过大;视频资源采用H.265编码,减少传输体积。三是搭建双重缓存机制,开启浏览器缓存与服务器缓存:通过服务器配置设置图片、CSS、JS等静态资源缓存周期为365天,让用户再次访问时直接从本地读取;动态网站部署Redis缓存,将热门内容、常用数据存储于内存,读取速度比硬盘快10倍,大幅降低服务器重复计算压力。

3.1.3 CDN加速与服务器选址优化

地理距离是影响加载速度的重要因素,通过CDN加速与合理选址可实现资源就近分发,提升不同地区用户的访问速度。在服务器选址方面,目标用户集中于单一区域时,选择该区域数据中心部署服务器,例如某欧洲汽配企业将服务器从美国迁移至法兰克福后,德国市场LCP(最大内容绘制)时间从4.3秒压缩至1.8秒,排名回升至首页;日本化妆品品牌部署东京服务器后,本土加载速度从3.1秒降至1.2秒,自然流量增长65%。在CDN深度应用方面,全球用户覆盖场景下,采用“核心市场本地化+边缘市场CDN”模式,选择支持Anycast技术的CDN服务商(如Cloudflare、阿里云CDN),自动优化传输路径,同时在CDN节点部署边缘计算能力,实现动态内容本地化处理,某机械制造企业部署Cloudflare CDN后,全球平均FID(首次输入延迟)从120ms降至45ms,关键词排名提升23位。

3.2 稳定性优化:构建可靠支撑,提升搜索引擎信任度

服务器稳定性直接关系网站可访问性与数据安全性,是搜索引擎建立信任的关键,需从运行保障、灾备防护两个维度入手,提升服务器uptime(正常运行时间),确保全年故障率控制在极低水平。

3.2.1 运行稳定性保障

一是配置硬件冗余,选择多线BGP服务器,避免单线路故障导致服务中断;部署冗余电源、镜像硬盘,防止硬件单点故障,目标uptime需达到99.9%以上,减少因服务器宕机导致的爬虫抓取失败与用户流失。二是提升弹性扩容能力,针对促销活动、热点事件等流量峰值场景,采用云服务器的自动扩容功能,某服装品牌在黑五期间通过AWS自动扩容应对300%流量峰值,保持99.99%可用性,避免流量激增导致的服务器瘫痪。三是优化服务器运行环境,定期清理服务器冗余文件、日志文件,优化数据库查询语句,减少服务器负载;对服务器进行定期巡检,及时发现并解决运行异常,避免小问题升级为宕机故障。

3.2.2 灾备与数据安全保障

建立完善的灾备体系,防范数据丢失与恶意攻击,保障网站持续可用。一是实施定期备份机制,采用“全站备份+异地存储”策略,备份内容包括数据库、网页文件、配置文件,备份周期不超过7天,将备份数据存储于异地服务器,避免本地灾难导致备份失效,确保网站数据可快速恢复。二是优化服务器监控,部署服务器监控工具(如Zabbix、Prometheus),实时监控服务器CPU、内存、带宽、磁盘使用率等核心指标,设置异常预警机制,一旦出现指标超标或运行异常,及时发出预警并处理,避免故障扩大。

3.3 安全优化:规避SEO惩罚,提升网站信任权重

服务器安全是网站SEO的“底线”,需通过安全配置与防护部署,规避搜索引擎惩罚,提升网站信任度,具体可从HTTPS部署、安全防护、合规性优化三个方面实施。

3.3.1 全面部署HTTPS协议

HTTPS不仅是网站安全的核心保障,更是搜索引擎排名的重要信号,需按照规范部署并优化。一是选择合适的SSL证书,中小企业可选择免费的Let's Encrypt证书,大型企业或对信任度要求较高的网站(如金融、医疗)可选择OV/EV证书(显示企业名称,提升用户信任度)。二是规范部署流程,配置301重定向,将HTTP流量全部转向HTTPS,保留90%以上链接权重;启用HSTS预加载,防止SSL剥离攻击;修复混合内容问题,确保图片、JS、CSS等所有资源均采用HTTPS协议加载,避免浏览器标记“不安全”。

3.3.2 强化安全防护部署

部署全方位的安全防护措施,抵御各类恶意攻击。一是部署Web应用防火墙(WAF),抵御DDoS攻击、SQL注入、XSS跨站脚本等常见威胁,过滤异常访问请求,保护服务器与网站安全。二是启用IP黑白名单,限制异常IP访问,禁止恶意爬虫、攻击IP访问服务器,同时避免误封搜索引擎官方爬虫IP,确保爬虫正常抓取。三是定期更新服务器系统与软件,修补安全漏洞,关闭不必要的端口与服务,减少攻击入口;设置复杂的服务器登录密码,启用SSH密钥登录,提升服务器登录安全性。

3.3.3 合规性优化

遵循行业监管政策与搜索引擎合规要求,避免因合规问题导致SEO惩罚。例如,医疗行业网站需通过HIPAA认证,确保数据加密存储与用户隐私保护;所有网站需符合GDPR、CCPA等数据合规要求,明确用户隐私政策,避免因数据违规被搜索引擎降权。同时,定期检查网站是否存在被篡改、挂黑链等问题,一旦发现及时清理并修复,避免被搜索引擎检测到后实施惩罚。

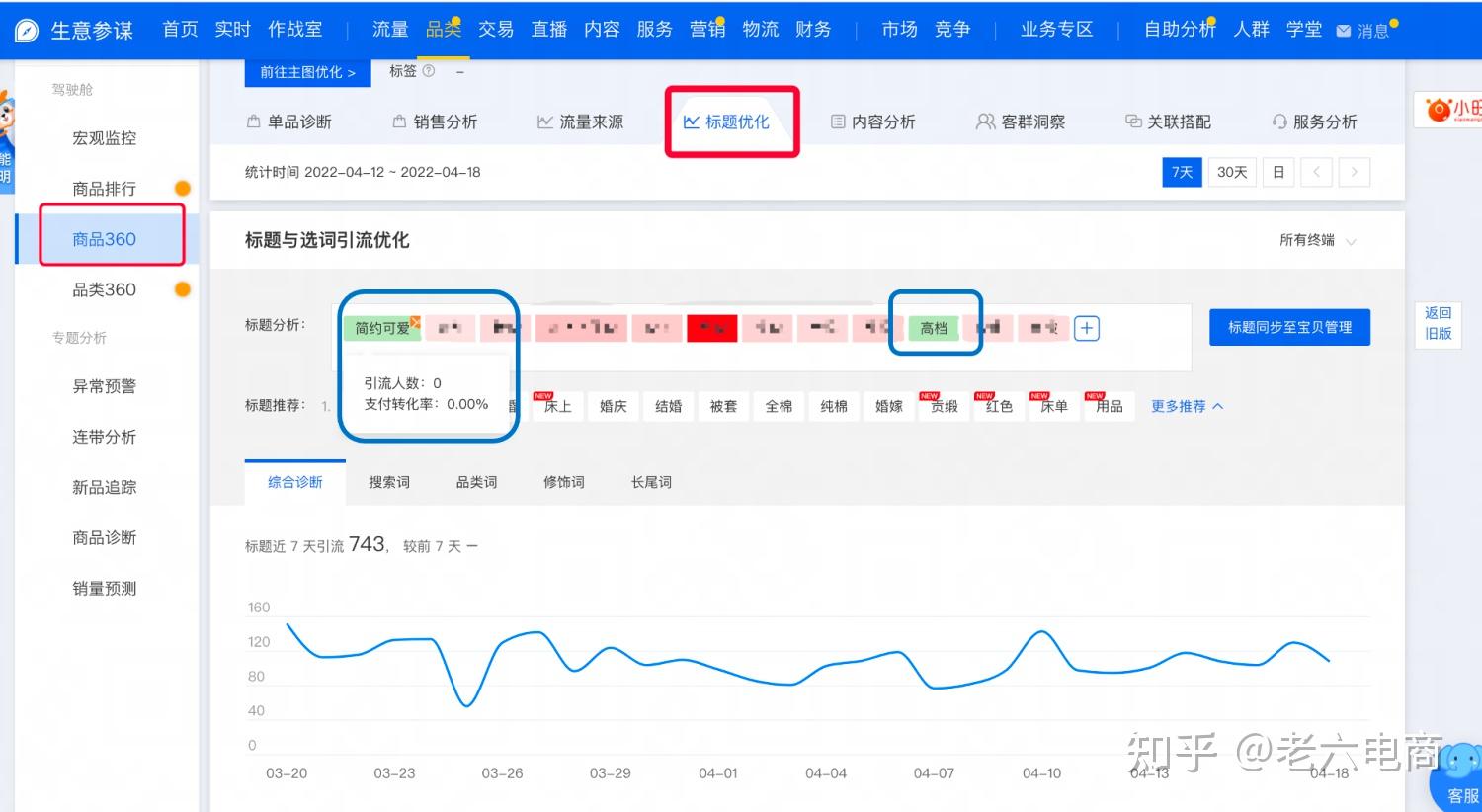

3.4 爬虫适配优化:提升抓取效率,增加收录量

针对搜索引擎爬虫的抓取逻辑,通过服务器配置优化,提升爬虫抓取效率,确保网站核心内容被全面、快速收录,具体可从爬虫访问控制、站点地图优化、抓取频率适配三个方面实施。

3.4.1 合理控制爬虫访问权限

通过robots.txt文件配置,明确搜索引擎爬虫的访问权限,引导爬虫优先抓取核心内容,避免抓取无关内容(如后台页面、测试页面),减少服务器负载。同时,禁止恶意爬虫访问,避免其占用服务器资源,影响正常爬虫抓取;确保robots.txt文件配置正确,避免误屏蔽搜索引擎官方爬虫,导致内容无法被收录。

3.4.2 优化站点地图与爬虫引导

创建清晰的站点地图(sitemap.xml),将网站所有核心页面、更新页面纳入站点地图,并提交至Google Search Console、百度搜索资源平台,引导爬虫快速发现并抓取网站内容,提升收录效率。同时,优化服务器响应头配置,设置合理的爬虫抓取间隔,避免爬虫访问过于频繁导致服务器负载过大,或访问间隔过长导致内容无法及时收录;针对动态页面,配置服务器端渲染(SSR),确保爬虫能够正常抓取页面内容,避免因JavaScript渲染导致内容无法识别。

3.4.3 适配爬虫抓取偏好

了解搜索引擎爬虫的抓取偏好,优化服务器配置以提升抓取体验。例如,爬虫优先抓取加载速度快、响应及时的页面,因此需确保服务器性能稳定,避免爬虫访问时出现超时;爬虫对新鲜内容敏感度高,因此需优化服务器内容更新机制,确保新内容发布后能够快速被爬虫抓取;针对多语言、多地区网站,配置服务器多语言支持,结合CDN节点,确保不同地区的爬虫能够高效抓取对应地区的内容。

四、Web服务器SEO优化实施路径与效果评估

4.1 优化实施路径

Web服务器SEO优化是一项系统性工程,需遵循“基础审计-优化实施-测试迭代”的闭环路径,确保优化效果落地,具体分为三个阶段:

4.1.1 第一阶段:基础审计(0-30天)

开展全面的Web服务器与SEO基础审计,明确优化痛点与优先级。一是服务器性能审计,检测服务器CPU、内存、带宽、磁盘使用率等核心指标,评估服务器负载情况;测试页面加载速度(通过Google PageSpeed Insights、百度速度诊断工具),定位加载延迟的核心原因(如带宽不足、缓存未启用)。二是SEO现状审计,通过Google Search Console、百度搜索资源平台,查看网站收录量、爬虫抓取频率、排名情况,分析是否存在降权、收录异常等问题。三是安全审计,检测服务器安全漏洞、是否部署HTTPS、是否存在被篡改、挂黑链等问题,评估服务器安全等级。基于审计结果,制定详细的优化方案,明确优化目标、实施步骤、责任分工与时间节点。

4.1.2 第二阶段:优化实施(30-90天)

按照优化方案,分模块落地优化措施,优先解决核心痛点。一是完成硬件资源优化,根据审计结果升级带宽、CPU、内存,更换SSD固态硬盘;二是实施性能优化,启用压缩技术、搭建缓存机制、部署CDN加速;三是强化稳定性优化,配置硬件冗余、启用自动扩容、建立定期备份机制;四是完成安全优化,部署HTTPS、WAF防火墙,修补安全漏洞;五是优化爬虫适配,配置robots.txt文件、提交站点地图、优化爬虫访问控制。在实施过程中,实时监控服务器运行状态与SEO指标变化,及时调整优化策略,避免出现优化失误导致的网站异常。

4.1.3 第三阶段:测试迭代(90天+)

优化实施完成后,开展全面测试与效果评估,持续迭代优化策略。一是性能测试,再次检测页面加载速度、服务器响应延迟等指标,对比优化前后的变化;二是SEO效果测试,查看网站收录量、爬虫抓取频率、关键词排名、自然流量等指标,评估优化效果;三是安全测试,检测服务器安全防护效果,模拟攻击测试,确保安全防护措施有效。基于测试结果,分析优化过程中存在的问题,调整优化策略,例如优化缓存周期、调整CDN节点分布、完善爬虫引导配置等;建立常态化优化机制,定期开展服务器审计与SEO评估,及时适配搜索引擎算法更新,确保优化效果的持续性。

4.2 效果评估指标体系

为科学评估Web服务器SEO优化效果,建立“服务器性能-爬虫抓取-SEO排名-用户体验”四维评估指标体系,具体指标如下:

4.2.1 服务器性能指标

核心评估服务器运行效率与稳定性,包括:服务器uptime(正常运行时间)、CPU使用率、内存使用率、带宽利用率、页面加载时间(首屏加载时间、完全加载时间)、服务器响应延迟。优化目标:uptime达到99.9%以上,CPU使用率稳定在80%以下,首屏加载时间≤2秒,服务器响应延迟≤100ms。

4.2.2 爬虫抓取指标

评估爬虫抓取效率与收录质量,包括:爬虫抓取频率、抓取成功率、网站收录量、核心页面收录率、内容更新收录时间。优化目标:爬虫抓取频率提升30%以上,抓取成功率≥95%,核心页面收录率100%,内容更新收录时间≤24小时。

4.2.3 SEO排名指标

评估SEO优化的核心效果,包括:核心关键词排名、长尾关键词排名、自然流量总量、自然流量转化率、网站权重(百度权重、Google PR值)。优化目标:核心关键词排名提升10-20位,自然流量总量提升50%以上,自然流量转化率提升15%以上。

4.2.4 用户体验指标

评估用户访问体验,间接反映SEO优化效果,包括:网站跳出率、平均停留时间、页面互动频率(评论、分享、点击)。优化目标:移动端跳出率≤65%、PC端跳出率≤55%,平均停留时间≥2分30秒,页面互动频率提升20%以上。

五、典型案例分析

为验证Web服务器SEO优化策略的可行性与有效性,选取两个不同类型的网站案例,分析其优化前的问题、优化措施与实施效果,为其他网站提供参考。

5.1 案例一:WordPress电商网站优化

5.1.1 优化前现状

该网站为基于WordPress搭建的中小型电商网站,主要销售家居用品,日均访问量约1000人次,优化前存在以下问题:服务器采用1核1G内存、机械硬盘,带宽为1M共享带宽,页面加载时间长达4.2秒,移动端跳出率高达75%;未启用缓存机制与CDN加速,服务器负载较高,高峰期频繁出现响应超时;未部署HTTPS,被Chrome浏览器标记“不安全”,核心关键词排名多在第3页以后,自然流量增长缓慢;未建立备份机制,曾因服务器故障导致数据丢失,影响网站收录。

5.1.2 优化措施

基于本文提出的优化策略,实施以下优化措施:一是升级服务器配置,更换为2核4G内存、SSD固态硬盘,将共享带宽升级为3M独享带宽;二是优化性能配置,启用Brotli压缩,部署Redis缓存,配置图片自动转换为WebP格式,启用非首屏图片延迟加载;三是部署阿里云CDN,实现资源就近分发;四是部署Let's Encrypt SSL证书,配置301重定向,修复混合内容问题;五是建立定期备份机制,每周进行全站备份并存储于异地服务器;六是优化爬虫适配,配置robots.txt文件,提交站点地图至百度与Google搜索平台。

5.1.3 优化效果

优化实施3个月后,该网站各项指标均得到显著提升:服务器uptime达到99.95%,CPU使用率稳定在65%以下,首屏加载时间从4.2秒降至1.1秒;爬虫抓取频率提升40%,抓取成功率达到98%,核心页面收录率100%,内容更新收录时间缩短至12小时;核心关键词排名平均提升18位,其中5个核心关键词进入首页,自然流量总量提升120%;移动端跳出率降至58%,平均停留时间延长至3分10秒,自然流量转化率提升22%;网站未再出现宕机与数据丢失问题,被搜索引擎判定为“优质网站”,权重显著提升。

5.2 案例二:跨国机械制造企业网站优化

5.2.1 优化前现状

该网站为跨国机械制造企业官网,面向全球用户,日均访问量约3000人次,优化前存在以下问题:服务器部署于美国,欧洲、亚洲地区用户访问延迟高达120ms,页面加载时间长达3.8秒;未部署CDN加速,全球访问体验不均衡;服务器稳定性不足,每月出现2-3次宕机,导致爬虫抓取频率下降,收录量减少;未优化爬虫适配,动态页面无法被爬虫正常抓取,核心产品页面收录率仅60%;HTTPS部署不规范,存在混合内容问题,部分地区用户无法正常访问。

5.2.2 优化措施

实施针对性优化措施:一是优化服务器选址,在欧洲(法兰克福)、亚洲(东京)新增服务器节点,实现核心市场本地化部署;二是部署Cloudflare CDN,启用Anycast技术,优化全球传输路径,在CDN节点部署边缘计算能力;三是配置多线BGP服务器与硬件冗余,启用自动扩容功能,提升服务器稳定性;四是优化动态页面,部署SSR服务器端渲染,确保爬虫正常抓取;五是规范HTTPS部署,更换OV SSL证书,修复混合内容问题,启用HSTS预加载;六是优化站点地图,按地区分区提交站点地图,适配不同地区爬虫抓取偏好。

5.2.3 优化效果

优化实施6个月后,网站优化效果显著:全球平均页面加载时间从3.8秒降至1.5秒,欧洲、亚洲地区访问延迟降至45ms以下;服务器uptime达到99.98%,未再出现宕机问题,爬虫抓取频率提升50%,核心产品页面收录率提升至100%;全球自然流量总量提升85%,其中欧洲、亚洲地区流量增长110%;核心关键词在全球主要地区的排名均进入首页,品牌曝光量显著提升;网站安全性得到保障,HTTPS合规率达到100%,用户信任度与转化率大幅提升。

六、Web服务器SEO优化未来趋势展望

随着搜索引擎算法的不断升级与互联网技术的快速发展,Web服务器SEO优化将呈现出自动化、智能化、多元化的发展趋势,未来重点将集中在以下四个方面:

6.1 AI驱动的自动化优化成为主流

生成式AI技术将深度融入Web服务器SEO优化,各类AISEO工具(如147SEO、好资源AI)将实现服务器配置、缓存优化、爬虫适配等操作的自动化,减少人工干预,提升优化效率。例如,AI工具可实时监控服务器运行状态,自动调整缓存周期、带宽分配,适配搜索引擎算法更新;通过AI分析爬虫抓取数据,自动优化站点地图与robots.txt配置,提升抓取效率。预计未来3-5年,AI将替代60%以上的重复性优化工作,让网站运营者聚焦于核心内容创作与用户体验提升。

6.2 边缘计算与CDN深度融合

边缘计算技术将与CDN加速深度融合,实现动态内容的本地化处理与就近分发,进一步降低服务器响应延迟,提升不同地区用户的访问体验。边缘计算节点将具备更多的计算能力,可在边缘节点完成动态页面渲染、数据缓存、请求处理等操作,减少核心服务器负载,同时提升爬虫抓取效率。对于跨国网站而言,边缘计算与CDN的融合将成为提升全球SEO表现的核心手段。

6.3 绿色服务器成为优化新方向

随着“双碳”理念的普及,绿色服务器将成为Web服务器发展的重要趋势,同时也将成为搜索引擎排名的潜在参考因素。绿色服务器通过优化硬件配置、降低能耗、提高资源利用率,实现环保与性能的双重提升。未来,搜索引擎可能会将服务器能耗、资源利用率纳入排名评估体系,推动网站运营者采用绿色服务器,实现SEO优化与环保发展的协同。

6.4 合规性与安全性要求持续提升

随着数据安全法规的不断完善与搜索引擎对网站安全的重视,Web服务器的合规性与安全性优化将成为SEO优化的必备环节。未来,搜索引擎将进一步强化对网站安全的检测,对未部署HTTPS、存在安全漏洞、数据违规的网站实施更严厉的降权惩罚;同时,数据隐私保护、跨境数据传输合规等要求将更加严格,网站运营者需加强服务器安全防护与合规性配置,才能确保SEO效果的稳定性。

七、结论与建议

7.1 研究结论

本文通过对Web服务器与网站建设SEO优化的关联研究,得出以下结论:Web服务器作为网站运行的底层支撑,其性能、稳定性、安全性与爬虫适配能力,直接影响搜索引擎爬虫抓取效率、用户体验与排名权重,是SEO优化的“地基工程”;Web服务器SEO优化需围绕性能优化、稳定性优化、安全优化、爬虫适配优化四个核心维度,通过硬件升级、配置优化、技术部署等措施,实现“底层支撑强化-用户体验提升-爬虫抓取优化-排名权重提升”的闭环;科学的实施路径与效果评估体系,是确保优化效果落地的关键,而AI技术、边缘计算等新技术的应用,将推动Web服务器SEO优化向自动化、智能化方向发展。

7.2 实践建议

基于本文研究结论,为网站运营者提出以下实践建议:一是重视Web服务器的底层支撑作用,将服务器优化纳入SEO整体策略,避免“重内容、轻底层”的优化误区;二是结合网站规模、流量需求与目标用户分布,合理配置服务器硬件资源,优先选择SSD固态硬盘、独享带宽与多线BGP服务器;三是建立常态化的服务器审计与优化机制,定期检测服务器性能、安全性与爬虫抓取情况,及时适配搜索引擎算法更新;四是积极应用新技术,部署CDN加速、Redis缓存、SSR服务器端渲染等技术,提升优化效果;五是注重合规性与安全性,全面部署HTTPS,强化安全防护,规避SEO惩罚;六是借助AISEO工具,提升优化效率,实现自动化优化与迭代。

7.3 研究不足与展望

本文的研究仍存在一定不足:一是案例选取的数量有限,且主要聚焦于中小型电商与跨国企业网站,对其他类型(如资讯、医疗)网站的适用性有待进一步验证;二是对Web服务器SEO优化与搜索引擎算法更新的动态适配研究不够深入,未能涵盖所有算法细节;三是未对不同优化策略的投入产出比进行量化分析。未来的研究可扩大案例范围,覆盖更多类型的网站,深入分析搜索引擎算法更新与服务器优化的适配关系,量化不同优化策略的效果与成本,为网站运营者提供更精准的优化参考。

上一篇:网站图片优化技巧(解决打开速度慢问题)

下一篇:解锁网站移动友好的密码

相关文章

相关文章

精彩导读

精彩导读

热门资讯

热门资讯